5 ¿Por qué no simplemente hacer IA? – Parte 1

La segunda posición extrema cuando se trata de IA es el uso indiscriminado o el mal uso de la tecnología. La IA funciona de manera diferente a la inteligencia humana, ya sea debido a la naturaleza de la situación, su diseño o los datos, los sistemas de IA pueden funcionar de manera diferente a lo esperado.

Por ejemplo, una aplicación desarrollada usando un conjunto de datos para un propósito no funcionará tan bien con otros datos y otro propósito. Vale la pena conocer las limitaciones de la IA y corregirlas. Es bueno no solo hacer IA sino aprender sobre sus ventajas y limitaciones.

Perpetuación de estereotipos

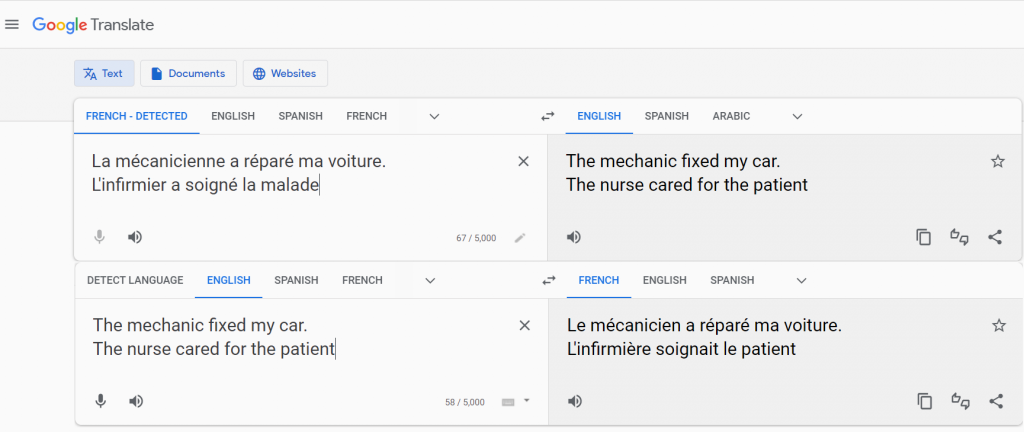

Google Translate aprende cómo traducir de internet. Sus ‘mineros de datos’ buscan en la web pública datos de los cuales aprender. Junto con el lenguaje, la IA aprende que el número de mecánicos masculinos es mayor que el de mecánicas femeninas, y que el número de enfermeras femeninas eclipsa al de enfermeros masculinos. No puede diferenciar entre lo que es ‘verdadero’ y lo que es resultado de estereotipos y otros prejuicios. Así, Google Translate termina propagando lo que aprende, cimentando aun más los estereotipos1:

Los problemas surgen en la IA siempre que un caso individual difiere del caso mayoritario (ya sea que esto represente fielmente a la mayoría en el mundo real o solo a la mayoría según la representación de internet). En las aulas el profesor tiene que compensar las fallas del sistema y, cuando es necesario, dirigir la atención del estudiante al texto alternativo.

Explora

¿Puedes buscar un estereotipo en Google Translate? Juega traduciendo de y hacia diferentes idiomas. Al hacer clic en las dos flechas entre las cajas, puedes invertir lo que se está traduciendo (esto es lo que hicimos para el ejemplo mostrado anteriormente).

Idiomas como el turco tienen la misma palabra para ‘él’ y ‘ella’. Muchos estereotipos salen a la luz al traducir del turco y a la inversa. Note que muchos idiomas tienen un sesgo masculino: se asume que una persona desconocida es hombre. Esto no es un sesgo de la aplicación. Lo impactante en nuestro ejemplo anterior es que el enfermero masculino se cambia a femenino.

Múltiples medidas de precisión

Adaptado de Resumen del impacto de la IA en educación por de la Higuera e Iyer (2022). Traducción del texto en la imagen por Rodríguez Enríquez.

Fuente: AI for Teachers: An Open Textbook, capítulo “Why not just do AI – Part 1”. Licencia: CC BY 4.0. https://pressbooks.pub/aiforteachers/chapter/why-not-just-do-ai-part-1/

Los sistemas de IA hacen predicciones sobre qué debería estudiar un estudiante a continuación, si ha comprendido un tema, qué división de grupo es buena para una clase o cuándo un estudiante está en riesgo de abandonar. A menudo, estas predicciones tienen un porcentaje adjunto. Este número nos dice cuán buena es la estimación del sistema sobre sus predicciones.

Por su naturaleza, las predicciones pueden ser erróneas. En muchas aplicaciones, es aceptable tener este error. En algunos casos, no lo es. Además, la forma en que se calcula este error no es fija. Hay diferentes medidas, y el programador elige lo que él o ella piensa que es más relevante. A menudo, la precisión cambia según el propio input.

Dado que en un aula, estos sistemas hacen predicciones sobre estudiantes, es tarea del profesor juzgar qué es aceptable y actuar cuando una decisión tomada por la IA no es apropiada. Para hacer esto, un poco de conocimiento sobre técnicas de IA y los errores comunes asociados con ellas será de gran ayuda.

1 Barocas, S., Hardt, M., & Narayanan, A. (2023). Fairness and machine learning: Limitations and opportunities. MIT Press. https://fairmlbook.org/